【管理人の独り言】

【管理人メルマガ】副業でも稼げるヒミツ

僕が副業で毎月何万円も稼いでいるヒミツを

メール読者さん限定で公開しています。

なぜ、時間がないサラリーマンでも

毎月何万円も稼ぐことが出来るのか?

100万円以上投資して得たスキルと実践で得たテクニックを

超初心者の方でもすぐに実践出来るよう噛み砕いて解説しています。

僕からのメールを何通か読み終わるころには、あなたも、

副業で稼ぐことができるヒミツが理解できるようになるはずです。

これから副業を始めようかなという人はもちろん

既に本格的に始めているあなたも大歓迎です!

読者皆さんが様々な事で、個人で稼げる能力をつける事が出来たら嬉しいですね。

【管理人メルマガの宣伝 終わり】

画像からAIで立体を作る方法

- 更新日:

- 公開日:

画像からAIで立体を作る方法

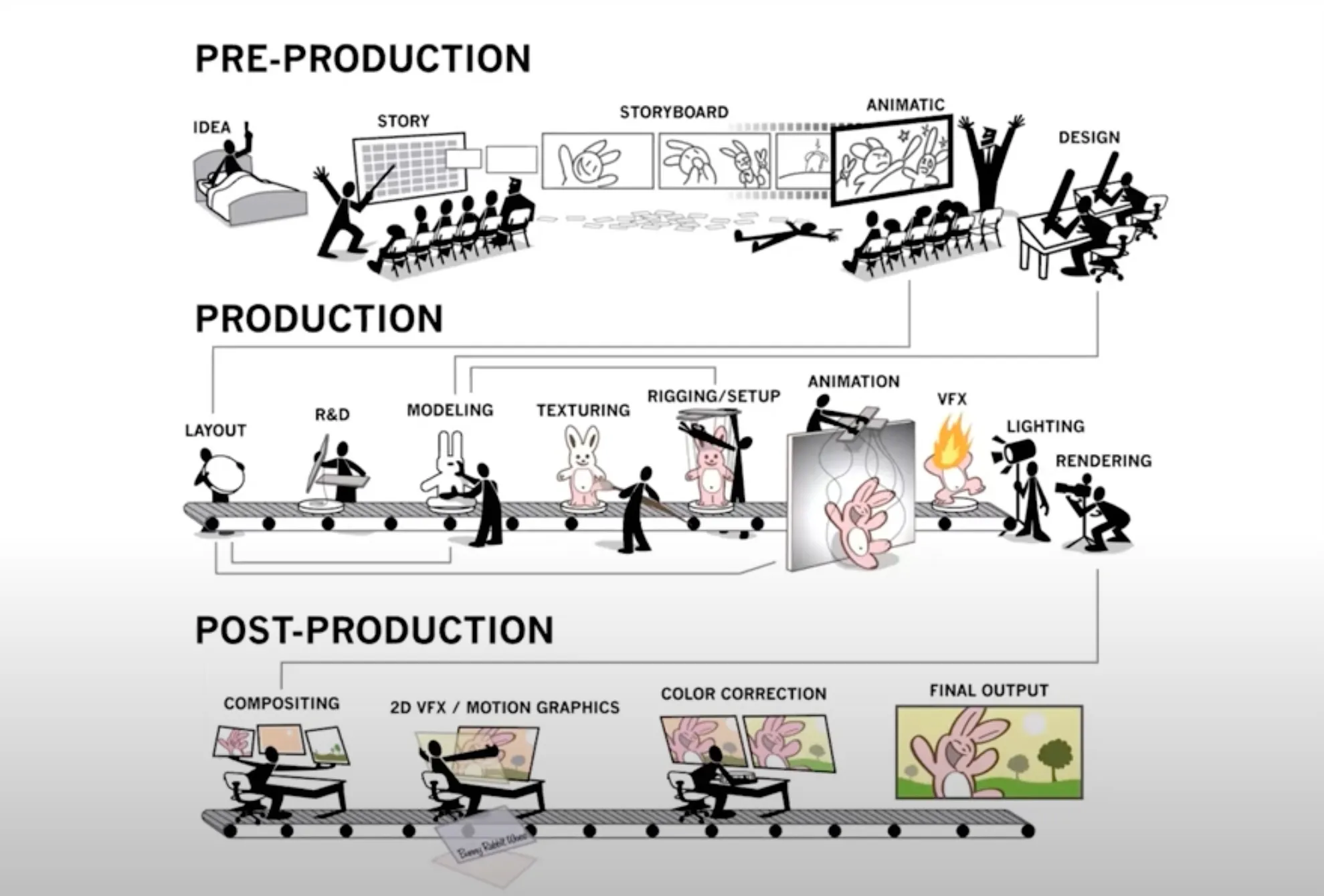

3D モデルを作るには奥行きや裏側の情報が欠けているため単一画像からの再構築は難題です。それでも最近のAI研究や商用ツールでは「それっぽい立体」を生成できるようになっています。ここでは最先端のアルゴリズムから一般向けツールまで幅広く整理し、必要な注意点もまとめます。

AIによる単一画像からの3D再構築技術

| 技術/モデル |

ポイント・仕組み |

参考情報 |

| SAM 3D (Meta) |

実画像の物体を1枚の写真から復元する研究モデル。形状・質感・配置などを推定し、複数物体でも自然な3Dシーンを生成できる。ユーザーは画像内の対象を選ぶだけで、カメラを回して異なる角度から眺められる。3Dデータが不足する問題を解決するため大規模な注釈データとマルチステージ学習を採用し、従来法よりも高品質と評価されている。 |

Meta Researchブログ (2025 年)。 |

| TripoSR (Stability AI/Tripo AI) |

TransformerとNeRFを組み合わせたモデルで、単一画像から3Dメッシュを0.5秒以内に生成する。画像エンコーダが特徴を抽出し、トライプレーン表現へデコードしてNeRFが色と密度を推定する仕組み。大量のデータ整備やレンダリング手法の工夫により高速化と精度を両立。 |

Analytics Vidhya記事 (2024 年)。 |

| DreamGaussian |

スコア蒸留型の最適化手法を改良し、3D Gaussian Splatting を用いて高速に3D生成するモデル。メッシュへの変換とUVテクスチャ補正を組み込んでおり、従来より約10倍高速に1枚の画像から2分で高品質なテクスチャ付き3Dモデルを生成できる。 |

ICLR 2024 論文。 |

| Zero‑1‑to‑3 / Zero123 |

大規模拡散モデルの幾何学的事前学習を利用し、カメラ視点の操作を学習することで単一画像から新規ビュー生成と3D再構築を実現。合成データで訓練した条件付き拡散モデルが、指定したカメラ変換に応じた複数視点画像を生成し、これをNeRFに流用する。実環境画像や絵画にもゼロショットで適用でき、既存手法を上回ると報告。 |

Columbia大学。 |

| NeuralLift‑360 |

単一画像から360°ビューに対応した3Dオブジェクトを生成する研究。深度推定を活用したNeRFと、CLIPに基づく拡散モデルを組み合わせ、ラフな深度情報とランキング損失で現実世界の写真に適用。既存のNeRF系手法より視覚的に一貫した結果を出す。 |

テキサス大学オースティン。 |

これらのモデルはまだ研究色が強く、出力の解像度や形状の歪み、多物体の相互作用といった制約も指摘されています。しかし、単一画像から「それっぽい立体」を作る技術としては最先端です。研究者向けですが、TripoSR や DreamGaussian はオープンソースで推論コードを公開しているので試すこともできます。

消費者向けAI 3Dモデリングツール

| ツール |

特徴 |

適した用途・注意点 |

| Tripo AI / Meshy AI |

クラウドベースのAI生成サービス。画像やテキストから高解像度の3Dモデルを数秒で生成し、AIテクスチャ生成やリトポロジーもサポート。Meshyでは「2D→3D を1分以内で実現」と謳い、写真やイラストをアップロードするとAIが詳細な3Dモデルを作成する。 |

ゲームやAR/VR用のプロトタイプ、コンセプト制作に便利。生成モデルのため背面や細部は推測によって補われる。 |

| Polycam (AI Model Generator) |

スマホから簡単に3DキャプチャできるアプリにAIモデル生成機能が追加。1枚の画像から粗い3Dモデルを作成でき、Blender・Unityなどへのエクスポートが可能とされる。本来はフォトグラメトリやLiDARキャプチャが得意で、LiDAR搭載端末では高速かつ精度の高い3Dスキャンが行える。 |

簡易なアイデアスケッチや低精度モデルに向く。詳しい裏面形状や細部は修正が必要。 |

| uMake / Model AI |

モバイル用3D設計アプリ。AIベースの画像→3D機能やテキストからの生成があり、スケッチからモデリングまで一貫して行える。ブログでは「AIにより2D画像から数秒で詳細な3Dモデルを生成でき、作業時間を最大99%短縮する」と強調している。 |

デザイナーや教育向け。高解像度・明るい背景の写真が結果の品質を大きく左右し、モデルのポリゴン数やテクスチャは後処理が必要になることもある。 |

これらのツールは誰でも手軽に使える反面、生成結果は「それっぽい」形状やテクスチャであり、精密な工業用途には向きません。ゲーム・映像用のラフなアセットやアイデア出し、SNS用コンテンツなどに適しています。

伝統的な手法:フォトグラメトリと3Dスキャン

AI生成とは別に、精度を重視するならフォトグラメトリや3Dスキャンが今も主流です。フォトグラメトリは「多数の重複する写真から3Dモデルを生成する技術」で、人工衛星や文化遺産のデジタル保存など広い分野で使われています。基本原理は、様々な角度から撮影した画像に共通する特徴点を検出し、幾何学アルゴリズムで座標を計算することです。写真の枚数が多いほど精度とディテールが向上し、50〜200枚撮影して重複を確保すると良い。単一画像では情報が不足するため、1枚からのフォトグラメトリは不可能です。

主なフォトグラメトリ/スキャンソフト:

-

Agisoft Metashape – 考古学や映画業界で愛用される精度重視のプロ用ソフト。ジオリファレンスや正射画像生成など豊富なツールを備え、大量かつ複雑なデータセットでも安定して処理できる。ただし学習曲線は急で高価。

-

RealityCapture – 巨大データセットを高速に処理することで知られ、数千枚の写真でも短時間で計算が完了。ゲーム開発や仮想撮影に重宝する。

-

3DF Zephyr – 使いやすさと機能のバランスが良いフォトグラメトリソフト。無料版があり初心者でも始めやすい。

-

Polycam (フォトグラメトリモード) – iOS/Android向けアプリ。スマホのLiDARやカメラを使い簡単に3Dキャプチャできる。

これらは多視点画像を前提とするため撮影に手間はかかりますが、測量や考古学、アニメ・ゲーム制作など高精度な3Dモデルが必要な用途には最適です。

良い結果を得るためのポイント

-

画像品質: AI生成でもフォトグラメトリでも、入力画像の品質が結果を大きく左右します。高解像度で均一な照明、無地の背景、中心に対象物を置くと精度が向上します。

-

複数角度の写真: フォトグラメトリでは50〜200枚の写真を角度や高さを変えて撮影し、重複部分を多く含めると良い。

-

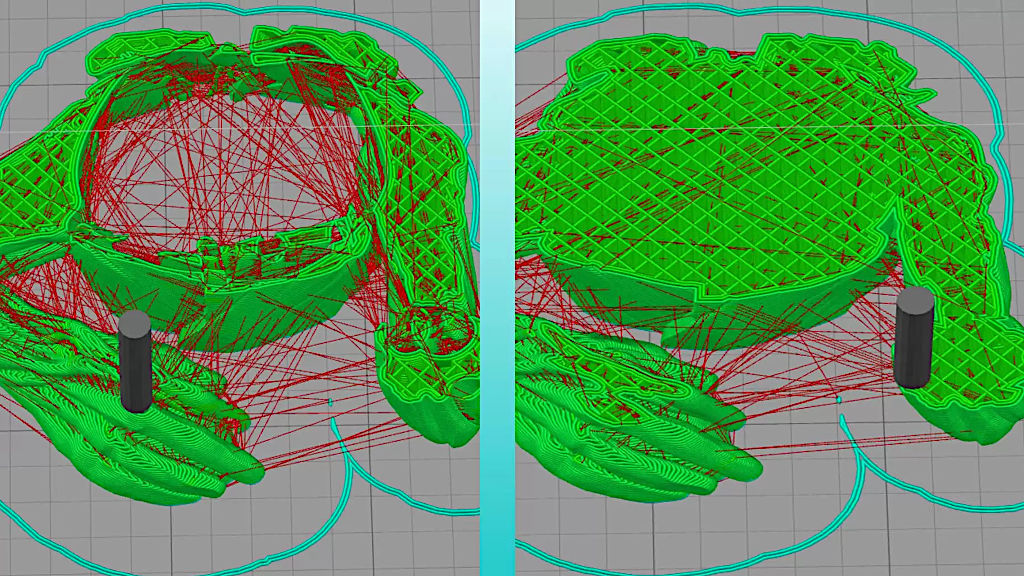

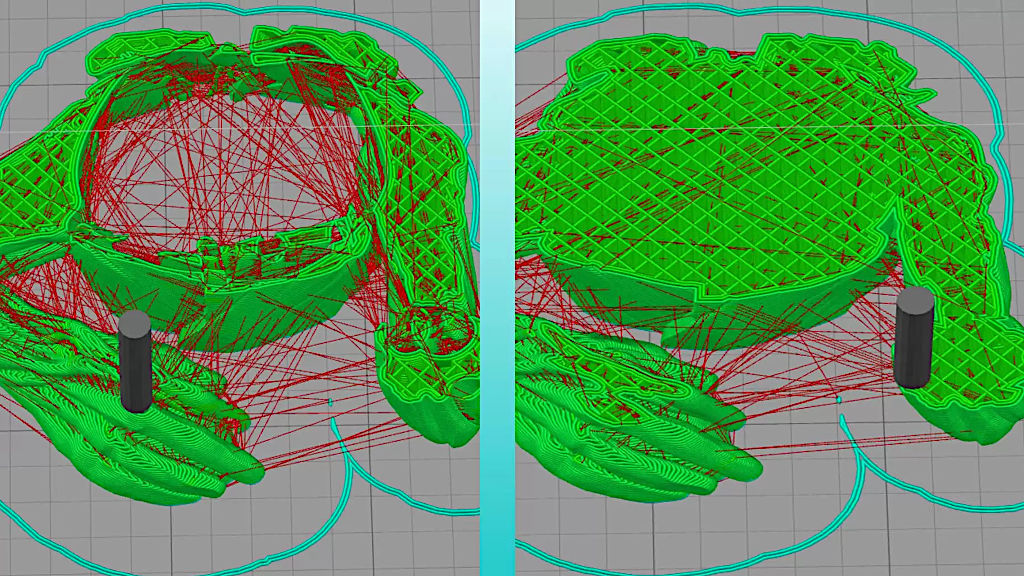

後処理: AI生成モデルで得たメッシュは裏側の形状や細部が推測に基づくため、BlenderやFusion 360などで修正・再トポロジーを行うと品質が向上します。

-

用途を見極める: ラフなデザインやゲーム用アセットならAI生成、正確な寸法や詳細が必要な工業/文化遺産用途ならフォトグラメトリやレーザースキャンが向いています。

まとめと選択のヒント

-

最先端研究モデル: SAM 3DやTripoSR、DreamGaussianなどは単一画像から詳細な3Dモデルを生成できる研究成果です。まだ商用利用には制約がありますが、オープンソース版を試せば品質を実感できます。

-

一般向けAIツール: Tripo AI、Meshy AI、PolycamのAIモデル生成機能などは「数秒でそれっぽい3D」を作るのに便利です。ゲームやAR/VRの素早いプロトタイピング、プレゼン用ビジュアルに適しています。

-

高精度が必要なら: 多数の写真を使ったフォトグラメトリやLiDARスキャンを検討しましょう。写真撮影のコツやソフトの選択が成果を大きく左右します。

用途に応じて適切な方法を選び、必要に応じて後処理や複数技術の組み合わせでクオリティを高めるとよいでしょう。

「先ほど調べた最新AI技術」+「最終目的が3Dプリント」を同時に満たす最適解

了解しました。

「先ほど調べた最新AI技術」+「最終目的が3Dプリント」を同時に満たす最適解を、技術的に・実務的に評価して結論を出します。

結論(最適解)

✅ Meshy(または Tripo AI) → Fusion 360仕上げ → STL → 3Dプリント

これが

2026年時点での「成功率・再現性・手戻りの少なさ」すべてを満たす最適解です。

なぜこの結論になるか(比較評価)

1️⃣ 研究モデル系(SAM 3D / DreamGaussian / Zero123 など)

評価:❌ 今回は不適

- 単一画像3Dの学術的には最先端

- しかし…

- 出力が NeRF / Gaussian / 疑似メッシュ

- STLに直接使えない

- watertightでない

- 研究としては面白いが

👉 「3Dプリント目的」では後処理コストが高すぎる

2️⃣ フォトグラメトリ(Polycam / RealityCapture)

評価:△ 条件付き

- 精度は最強

- ただし

- 複数角度(50〜200枚)必須

- 実在物が必要

- 犬写真1枚では不可

👉

今回は前提条件を満たさない

3️⃣ 商用AI Image→3D(最適ゾーン)

🥇 Meshy

🥈 Tripo AI

この2つが頭一つ抜けています。

| 観点 |

Meshy / Tripo |

| 単一画像 |

✅ |

| メッシュ出力 |

✅ |

| STL/OBJ |

✅ |

| 形が丸い |

✅ |

| 裏側補完 |

自動 |

| 3Dプリント適性 |

高(要仕上げ) |

👉

「それっぽい犬の置物」には最短距離

ただし:AI単体では「未完成」

ここが一番重要です。

AIは「形を想像する」

Fusion 360は「物として成立させる」

役割を混ぜると失敗します。

Fusion 360で必須の後処理(3Dプリント前提)

✔ 必須①:底面を切る

- 犬単体は必ず倒れる

- 足裏 or 腹下面を完全平面化

✔ 必須②:肉抜き(中空)

- 樹脂節約

- 反り・失敗防止

- 壁厚目安

- FDM:2.0〜2.5mm

- レジン:1.5〜2.0mm

✔ 推奨③:台座一体化

✔ 必須④:watertight確認

あなたのケースに最適化した「最短ルート」

🧭 決定版フロー

- Bing画像 → Meshy(第一候補)

- OBJ or STL 出力

- Fusion 360

- STL書き出し

- スライサ → プリント

なぜ「Meshy > Tripo AI」か(僅差)

- Meshyの方が

- → Fusionで削りやすい

→ 置物向き

(Tripo AIはややシャープでゲーム向き)

失敗しないための重要な割り切り

❌ 写真そっくりを狙わない

⭕

「丸い・太い・簡略化」が正義

❌ AIだけで完結しようとしない

⭕

Fusionで完成させる

次にやると一気に完成します

ここまで決まったので、次は

実装レベルに入れます。

次の質問(1つだけ教えてください)

👉

3Dプリンタは何方式ですか?

これが分かれば、

- Fusion 360での具体操作手順

- 最適な肉厚・穴径

- STL出力設定

まで 完全に決め打ちで書きます。